Unreal Engine 5 kan sinds vandaag gedownload worden

Na een lange wachtperiode is Unreal Engine 5 sinds vandaag officieel te downloaden.

Wie aan de slag wil om de mogelijkheden van de software uit te testen of meer informatie wil vernemen, kan terecht op volgende link.

Unreal Engine 5 biedt, naast de mogelijkheden voor de gaming sector, ook voor de media- en audiovisuele sector heel wat opties op het gebied van virtuele werelden, studio’s, assets en meer.

Ook Sony zet zijn technologie in om virtuele productie mogelijk te maken!

Simulcam: wat is het en wat doet het?

Dimension, DNEG, Sky Studios, en UK creative partners geven in beknopte episodes een overzicht van hun learnings bij hun virtual production project.

In deze episode krijg je een zeer beknopt overzicht van de mogelijkheden van Simulcam.

Virtual production testcase: DJ Yolotanker

Wat is eXtend?

Thomas More Research startte in november 2020 met het onderzoeksproject genaamd eXtend. Met dit onderzoek wil Thomas More in samenwerking met MediaNet Vlaanderen en Vlaio de Vlaamse broadcastsector tools geven om nieuwe XR-technologie te omarmen. De focus binnen eXtend ligt op vernieuwende, democratische XR-technologie die geïmplementeerd kan worden in het productieproces. We kijken naar technologieën zoals: motion capture, face capture, 2D en 3D avatars, 360 graden multicam captatie, virtual production, fotogrammetrie, 3D rigging, LiDAR scanning, …

Virtual production: Jaar 1

In jaar 1 hebben we volop getest met verschillende virtual production opstellingen. Het doel van deze eerste testen was om het principe achter virtual production te begrijpen. Onze opstelling bestond uit Vive tracker en Vive base stations. We bevestigden de Vive tracker boven onze camera waardoor we de positie van de camera konden tracken. Deze positionele data konden we gebruiken om een virtuele omgeving (Unreal Engine) aan te sturen. Al snel zagen we het potentieel van virtual production. De combinatie van cameratracking en Unreal Engine (game engine) maakt een ongeziene expansie van creativiteit en efficiëntie mogelijk.

Daarnaast werden we ook geconfronteerd met de beperkingen van ons systeem. Ondanks dat het gebruik van ‘huis tuin en keuken’ VR-materiaal een prima startpunt was voor jaar 1 stonden we in jaar 2 met meer ambities in de greenkey studio. Daarom besloten we het tracking systeem van Antilatency aan te kopen. Dit relatief goedkoop trackingsysteem levert zeer betrouwbare tracking data aan en is bovendien modulair. Hierdoor kunnen we op termijn makkelijk uitbreiden indien nodig (tracking oppervlakte & hoeveelheid getrackte objecten).

Virtual production: Jaar 2

Na verschillende kleinere experimenten wilden we graag een testcase opzetten waarbij we vanaf nul konden beginnen. We kwamen op het idee om een virtuele DJ set te organiseren met DJ Yolotanker, wat ons betreft a match made in heaven! Vanwege de uitstraling van DJ Yolotanker kon, mocht en moest de virtuele wereld zo absurd mogelijk zijn. Om tot een succesvolle testcase te komen moesten we wel nog heel wat stappen zetten. Het doel was namelijk om de captatie in één keer te doen. We zouden dus een multicam setup moeten kunnen realiseren. Daarnaast moest er natuurlijk ook een virtuele wereld/decor gemaakt worden. Meer dan genoeg werk om te starten!

Vooronderzoek

Tijdens het vooronderzoek legden we ons toe op drie aspecten: 1. cameratracking, 2. multicam en 3. live. Het doel was om aan te tonen dat we d.m.v. virtual production een multicam captatie live konden realiseren rekening houdend met een beperkt budget.

- Cameratracking

In eerste instantie was het belangrijk om te leren werken met ons nieuw tracking systeem. De soft- en hardware van Antilatency liet ons toe om efficiënt trackingdata in de Unreal omgeving te krijgen. Vanaf onze eerste testen in jaar 1 tot en met onze DJ Yolotanker testcase kenden we behoorlijk veel problemen met kalibratie. Het bleek niet zo eenvoudig te zijn om de echte studio en de trackingdata te kalibreren met de virtuele omgeving. Ondanks het feit dat we dit proces natuurlijk nog volop aan het leren waren bleef dit vaak een bron van behoorlijk wat slapelozen nachten en de nodige frustratie. Ondertussen zijn er nieuwe tools uit (Aruco marker) die het veel makkelijker maken om de kalibratie op een degelijke manier te doen waardoor de studio’s veel makkelijker matchen.

2. Multicam

Een ander focuspunt was de multicam captatie. We beschikten over een URSA Mini Pro 4.6K (met een Antilatency tracker) en een fixed camera. Ondanks onze bescheiden setup konden we gebruik maken van fysieke camerabewegingen gemixt met virtuele camerabewegingen. Het werd dus mogelijk om verschillende P.O.V. te maken (bv. super wide, kraan travel, dolly travel,…).

3. Live

We moesten ons tot slot ook toeleggen op het live aspect. Hoe kunnen we een virtual production live capteren en uitzenden? Om dit grondig te testen deden we een mini testcase waarbij we live onderzoeksresultaten voorstelden vanuit een virtual studio.

Tijdens deze mini testcase kozen we slechts voor één camera: de tracked URSA Mini Pro 4.6K. We werkten wel met fysieke bewegingen gemixt met virtuele cameratravels.

Conclusie vooronderzoek

Tijdens het vooronderzoek slaagden we erin om alle stappen te doorlopen die we nodig zouden hebben tijdens de testcase met DJ Yolotanker. We waren tevreden met de geboekte resultaten en keken met enig vertrouwen naar de volgende stappen. We waren er ons wel van bewust dat we voldoende tijd moesten voorzien om rond de voorgaande kalibratie problemen te werken en deze onder controle te houden.

Testcase DJ Yolotanker

Het doel van deze testcase was om een live multicam captatie te maken in een virtuele wereld (ontworpen en gemaakt door Design Source, studenten IMD). Uit onze voorgaande testen haalden we alle nodige tools en technieken om van deze testcase een succes te maken.

Setup

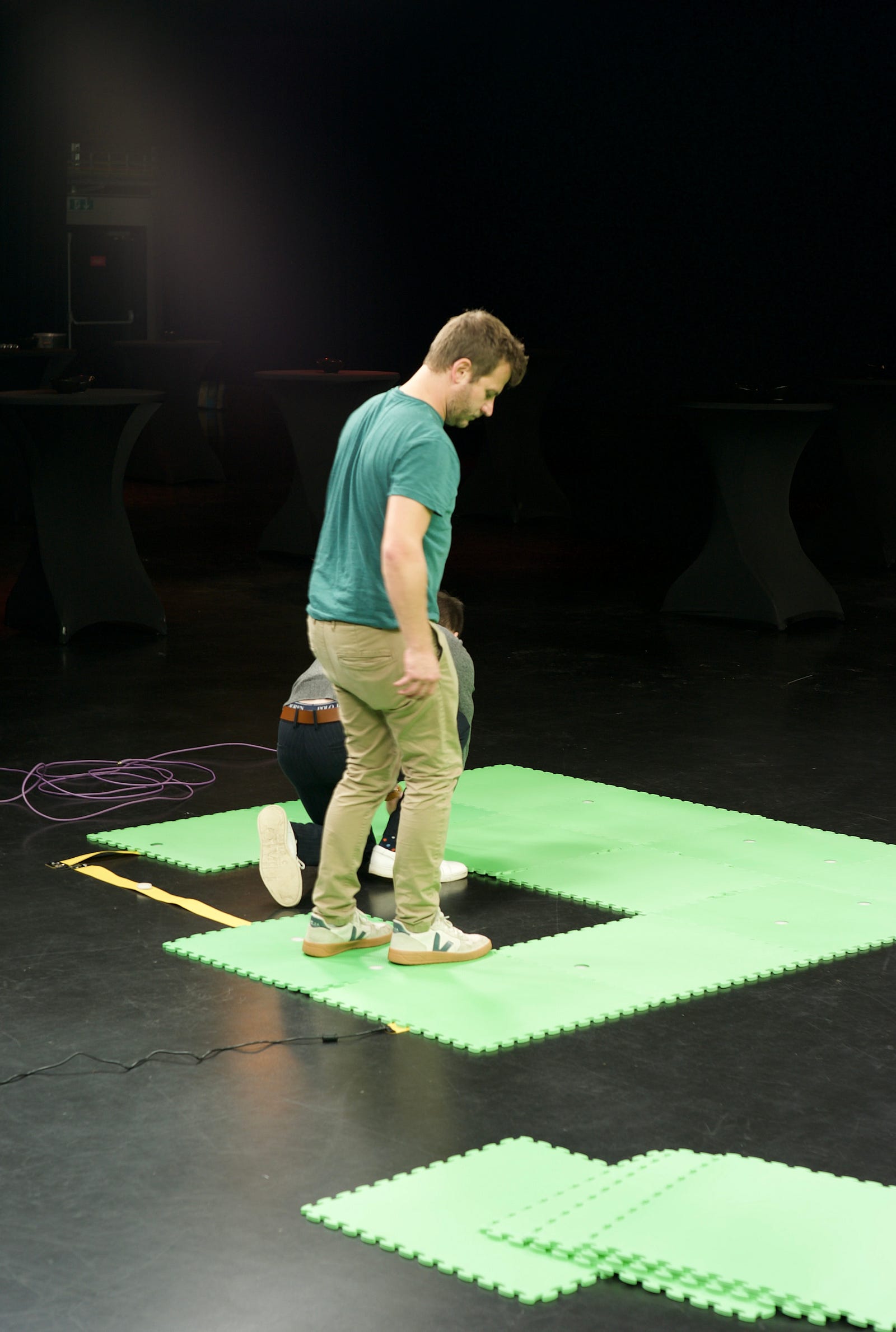

We kozen ervoor om met één tracked camera te werken (URSA Mini Pro 4.6K) en één fixed camera (Panasonic PTZ, zonder FreeD protocol). De URSA werd op een dolly geplaatst. Op deze dolly plaatsen we een kraan om zoveel mogelijk beweging te krijgen. De Antilatency tracking matten configureerden we in een baan onder onze dolly. Zo konden we de baan van de URSA volledige tracken.

Het podium voorzagen we van de nodige geluidstoestellen zodat DJ Yolotanker vlot aan de slag kon gaan. Daarnaast plaatsten we enkele echte objecten om de composite (echt beeld gemixt met de virtuele omgeving) beter te laten blenden. Tot slot plaatsen we nog een aantal grote schermen waar we de directe output op lieten zien. Zo kon DJ Yolotanker zich nog beter inleven.

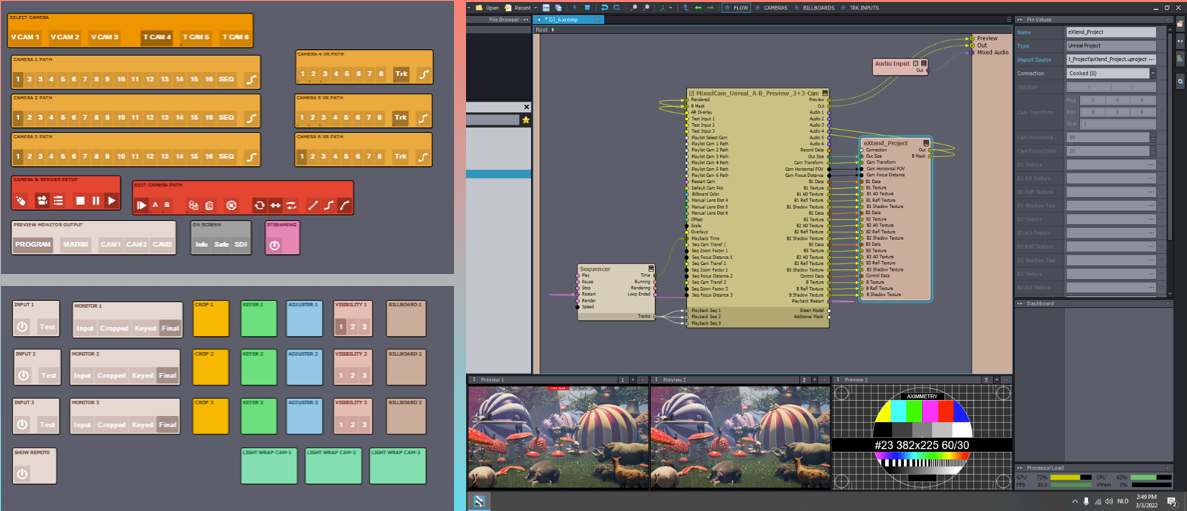

Naast de nodige hardware beschikten we ook over aantal software tools die ons hielpen deze testcase te produceren. We maakte gebruik van Unreal Engine om onze virtuele wereld in realtime te laten ‘meedraaien’. Daarnaast gebruikten we Aximmetry software die als een software laag boven Unreal Engine draaide waarmee we in een broadcastsoftware-omgeving konden werken. Dit maakten het voor ons veel makkelijker om o.a. de kalibratie en de multicam captatie te doen.

Het team tijdens de opnames bestond uit vier personen, 1) Dries (Antilatency, Unreal Engine & Aximmetry operator), 2) Ruben (virtuele regie), 3) Tom (cameraman), 4) Jonathan (cameraman & assistent regie).

Om een efficiënte analyse te maken van deze testcase zullen we een SWOT-analyse maken. Mochten er technische vragen zijn mag je ons altijd mailen via tom.verstappen@thomasmore.be

Strength

In jaar 1 waren we al zeer enthousiast over de mogelijkheden van virtual production. Tijdens deze grotere testcase groeide ons geloof in de mogelijkheden van deze technologie alleen maar verder. De creatieve mogelijkheden met virtual production zijn ongezien. Ondanks de pittige technische uitdaging is het kinderspel om bepaalde elementen in de virtuele set van plek te veranderen, verwijderen en/of toe te voegen. Daarnaast heb je absolute controle over bepaalde parameters zoals time of day op set.

De realtime composite bleek ook een van de sterktes te zijn. De crew kon zien wat ze filmden op set, zo konden we creatieve camerashots aanleveren die rekening hielden met de virtuele omgeving. Daarnaast vormde deze realtime feedback ook de basis voor DJ Yolotanker zijn optreden. Ondanks het feit dat hij in een greenkey stond had hij toch enorm veel feeling met de wereld waarin hij aan het optreden was.

Tot slot is de kracht van virtuele camerabewegingen gekoppeld aan fysieke camerabewegingen ongeëvenaard. We slaagde erin om ondanks de limitatie van slechte twee camera’s behoorlijk indrukwekkende P.O.V. aan te leveren. We konden namelijk fysieke travels koppelen aan een virtueel P.O.V. waardoor we konden faken dat we een kraanshot vanop 40 meter van het podium maakten.

Weaknesses

De grootste uitdaging voor ons was de kalibratie tussen de fysieke studio en onze virtuele omgeving. We ondervonden initieel zeer veel problemen. Later leerden we dat het moeilijk is om een zwevend podium als 0-punt te kalibreren. Ondertussen zijn er ook veel performantere manieren op de markt om de kalibratie te doen. De komst van hulpmiddelen zoals de Aruco marker maken het veel eenvoudiger om kalibratie te doen. Zie onderstaande YouTube link vanaf 3:50.

Daarnaast waren we natuurlijk ook beperkt in onze resources waardoor we kozen om ons op bepaalde zaken te focussen. In een ideale wereld zouden we deze piloot opnieuw doen met meerdere camera’s, straffere grafische kaarten, licht- en cameramensen, … Dit neemt niet weg dat we niet heel tevreden zijn met deze zeer geslaagde testcase.

Opportunities

We durven voorzichtig te stellen dat virtual production de toekomst is van de broadcastindustrie. Ja, virtual production is op dit moment nog steeds een kapitaalintensieve aangelegenheid MAAR we konden in onze testcase vaststellen dat er een aantal kosten worden gereduceerd en sommige zelfs volledige wegvallen. Daarnaast is de flexibiliteit van virtual production ongezien. Je kan veel meer filmen op een draaidag omdat je de set instant kan veranderen, hierdoor valt heel veel change-over time weg.

Los van de technische kant zien we ook enorm veel kansen op creatief vlak. Unreal engine biedt ongeziene mogelijkheden aan creatives om eender welke wereld te maken. Op termijn zal de enige bestaande limitatie ons creatief vermogen zelf worden, praktisch alles wat je kan bedenken valt te creëren in Unreal Engine.

Tot slot stellen we vast dat bij aanvang van het eXtend project de kosten om aan virtual production te doen enorm hoog waren. In jaar 2 konden we zelf vaststellen, door de aankoop van het Antilatency tracking systeem dat de prijzen democratischer worden. Deze trend zal zich blijven verderzetten waardoor alsmaar meer broadcastbedrijven deze technologie zal omarmen.

Conclusie & resultaat

Om af te ronden tonen we graag het uiteindelijke resultaat. Zoals eerder aangegeven kunnen we nog betere resultaten boeken met een uitgebreider team. Binnen de lijnen van het onderzoeksproject en deze testcase mogen we van een zeer geslaagde output spreken. We toonden aan dat we een volledige virtueel optreden, live en in multicam konden registreren op een democratische manier.

Dansen maar!

Wat is Pixel Pitch en waarom kan het belangrijk zijn bij Virtual Production?

‘Pixel Pitch’ is voor veel personen geen bekend begrip.

Volgende video duidt waarom het evenwel belangrijk kan zijn bij Virtual Production.

AWS at SIGGRAPH 2021 Keynote: Virtual Production ft. Epic Games and Amazon Studios

Op AWS gaven Epic Games en Amazon Studios een overzicht van de voornaamste voordelen en uitdagingen van virtual productions, en de wijze waarop deze technologie ook tijdens de huidige gezondheidscrisis een meerwaarde kan zijn.